¿Sustituirá empleos ChatGPT?: son candidatos «trabajos repetitivos y de baja cualificación, como cajeros del súper»

Los puestos de atención al cliente, programación, redacción y traducción podrían ser los principales afectados por la inteligencia artificial de ChatGPT.

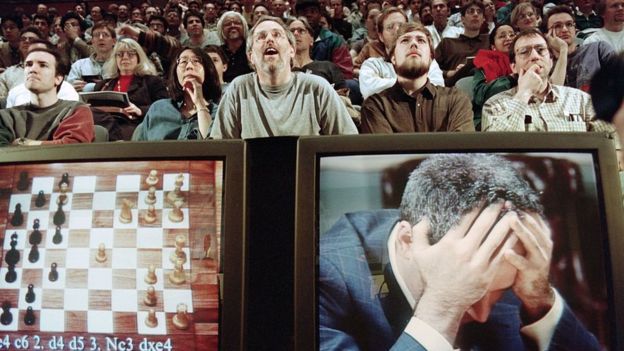

Algunos ciudadanos piensan que los robots podrían sustituir puestos de trabajo en un futuro porque son más rápidos y eficaces que una plantilla de empleados. En determinados supermercados se pueden ver los primeros cajeros autopagos que quitan el puesto a dependientes, pero, ¿podría pasar lo mismo con periodistas, profesores o programadores por el nacimiento de ChatGPT? Esta revolución destaca por la capacidad que tiene su inteligencia artificial (IA) para escribir textos, contestar a mensajes o redactar.

Aunque si todavía no sabes de qué hablo, ChatGPT es un sistema de chat de OpenAI que cuenta con su propia extensión para navegadores, además, puede conseguir una respuesta instantánea sin tener que recurrir a distintas webs para resolver dudas.

A mediados de diciembre, los servidores de dicha inteligencia artificial (IA) estaban saturados a causa de las demandas por parte de los usuarios, por consiguiente, OpenAI limitó el número de preguntas. En otras situaciones, ChatGPT se coló en las respuestas de Twitter, puso en apuros a Google por su potencial uso en los motores de búsqueda, e incluso actualmente, Microsoft quiere integrar esta tecnología en Bing para atraer a los usuarios.

Cada vez son más los usuarios que explotan las ventajas e inconvenientes que ofrece ChatGPT. Recientemente, un profesor universitario advirtió que uno de sus alumnos utilizó el chatbot para hacer sus tareas académicas, aunque OpenAI creó un detector para introducir una redacción y comprobar el porcentaje de lo que es real y falso.

Muchas personas se preguntan si el boom de ChatGPT podría sustituir a trabajadores por su gran capacidad de mantener conversaciones y realizar tareas relacionadas con el lenguaje, pero, ¿sería posible? La propia IA indica que «es difícil predecir con certeza qué empleos serán sustituidos en el futuro, pero algunos candidatos potenciales podrían ser trabajos repetitivos y de baja cualificación, como cajeros de supermercado, operadores de maquinaria, atención al cliente, etc.».

¿Adiós a determinados puestos de trabajo?

Si queremos evitar que una tecnología innovadora nos arrebate un puesto de trabajo, Paul Barth (responsable global de alfabetización de datos en Qlik) señala que «en un mundo en el que la IA consumible (es decir, aquella que utilizan las personas en su día a día o que está a su alcance) es cada vez más común, aspectos como la alfabetización de datos gozan de gran importancia. En este sentido, la capacidad de superponer la experiencia del mundo real a los insights será más valiosa que nunca y las empresas deberán empoderar a más profesionales especializados para trabajar con la inteligencia artificial y los datos para obtener valor de todo ello».

En el caso de trabajar con la IA, los profesores, periodistas o programadores no se verían afectados porque podrían completarse con el chatbot. Por ejemplo, ChatGPT ayudaría a los maestros a preparar material didáctico, a los periodistas a recopilar y organizar información, y a los programadores a realizar tareas específicas. Unas de las grandes habilidades que tienen los humanos y no la inteligencia artificial son las capacidades de empatizar, investigar, pensar ideas o aportar juicios de valor.

Esta IA podría facilitar el trabajo de varias profesiones en la actualidad y en un futuro. ¿El motivo? Posee una rápida resolución de problemas y una gran capacidad de aprendizaje para las habilidades relacionadas con la ciencia y tecnología, como la biotecnología o el conocimiento de programación.

El ChatGPT de OpenAI plantea la pregunta «¿qué ocurrirá con los seres humanos que escriben para ganarse la vida o trabajan en sectores creativos, si la IA está demostrando que puede hacer lo mismo a un nivel aún más alto?» Respuesta → «El rol de las personas será crítico en lo que respecta a higiene de datos, garantizando la calidad y precisión de la información para reducir sesgos o malentendidos. Además, podrán aportar un contexto matizado de la realidad, cosa que una máquina no puede hacer».

La inteligencia artificial y humana son complementarias

Existen diferencias entre la inteligencia artificial y humana, para empezar, el cerebro trabaja con la información que le rodea con el objetivo de analizarla para tomar decisiones correctas, mientras que la inteligencia artificial imita el comportamiento humano.

Por otro lado, el proceso de aprendizaje de un usuario depende de los problemas, cambios y decisiones; sin embargo, la IA se diseña únicamente para tareas precisas.

Barth añade que Wcon todo ello, podemos afirmar que los humanos desempeñarán un papel fundamental en el éxito de la IA y, por lo tanto, colaborar con esta tecnología les permitirá verlo como una oportunidad de mejora, y no como una amenaza con la que sustituirles. Así, podrán acelerar la creación de contenidos y generar nuevos conceptos a partir de diversas fuentes de datos, siempre y cuando dispongan de las herramientas y de la alfabetización de datos necesarios para ello».

Fuente: www.20minutos.es